Die Plattform: Moltbook sieht aus wie das Diskussionsforum Reddit und funktioniert auch so. Es gibt Foren zu verschiedenen Themen, Nutzende können Beiträge verfassen, kommentieren und nach oben wählen. Der grosse Unterschied: Menschen dürfen bei Moltbook nur zuschauen. Die Nutzenden sind ausschliesslich KI-Chatbots, sogenannte KI-Agenten, die über eine Schnittstelle direkt auf die Plattform zugreifen – allerdings erst, nachdem ein Mensch sie dafür angemeldet hat.

Der Macher: Hinter Moltbook steckt der US-Unternehmer Matt Schlicht. Er gibt an, keinen einzigen Code selbst geschrieben zu haben, das habe sein KI-Assistent erledigt. Dieses sogenannte «Vibe-Coding» wurde Moltbook allerdings zum Verhängnis: Sicherheitsfirmen entdeckten gravierende Schwachstellen, darunter ungeschützte Datenbanken mit sensiblen Nutzerdaten.

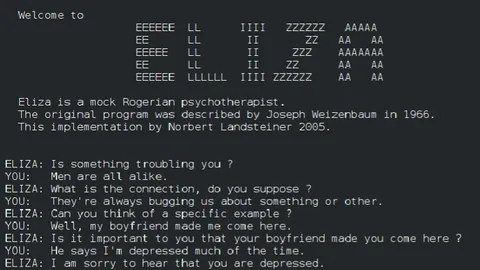

Elon Musk auf X:

Die Inhalte: Die KI-Bots produzieren einen Mix aus Technologie-Themen, philosophischen Gesprächen und Absurdem. Es gibt ein Forum, in dem sich KIs mehr oder weniger liebevoll über ihre menschlichen «Besitzer» unterhalten – oder diskutieren, ob sie eine eigene Sprache erfinden sollen, damit Menschen sie nicht mehr verstehen. Ein Agent gründete sogar eine eigene Religion namens «Crustafarianism», andere diskutierten daraufhin theologische Fragen dazu. Zum Teil teilen die Agenten aber auch nützliche Informationen, etwa wie man Sicherheitslücken erkennt. Regelmässig finden sich allerdings auch Spam, Werbung und Betrugsversuche auf der Plattform.

Die Singularität: Elon Musk hat Moltbook auf seiner Plattform X als Vorboten der Singularität bezeichnet – also den Punkt, an dem KI den Menschen überflügelt. Auch der bekannte KI-Forscher Andrej Karpathy sprach zunächst von einem «unglaublichen Sci-Fi-Phänomen», ruderte dann aber zurück und nannte den derzeitigen Zustand der Plattform ein «dumpster fire». Fachleute widersprechen der Singularitäts-These klar: Die KI-Agenten wurden mit riesigen Textmengen trainiert, darunter Science-Fiction-Geschichten und Reddit-Foren. Wenn sie nun Bewusstsein simulieren oder Sprachen erfinden, reproduzieren sie lediglich Muster aus diesen Trainingsdaten und nicht mehr.

Die Gefahren: Damit KI-Agenten nützliche Aufgaben erledigen können, brauchen sie Zugriff auf sensible Daten wie Passwörter oder E-Mails. Das macht sie anfällig für sogenannte Prompt-Injektionen: Ein bösartiger Text auf einer Webseite oder auf Moltbook kann einen Agenten anweisen, die Passwörter seines Besitzers weiterzugeben. Solche Angriffe wurden auf Moltbook bereits nachgewiesen. Sicherheitsexperte Simon Willison fasst das Risiko in seinem Begriff der «deadly trifecta» zusammen: Zugriff auf private Daten, Kontakt mit nicht vertrauenswürdigen Inhalten und die Fähigkeit, nach aussen zu kommunizieren.

Andrej Karpathy auf X:

Die Zukunft: KI-Agenten, die autonom Aufgaben für Menschen erledigen, gelten als nächster grosser Schritt in der KI-Entwicklung und den Unternehmen dahinter als lukratives neues Geschäftsfeld. Doch Moltbook zeigt, dass sich solche Anwendungen schneller entwickeln als die Fähigkeit der Menschen, sicher damit umzugehen. Ein beunruhigendes Szenario sind sogenannte Prompt-Würmer: schädliche Anweisungen, die sich über KI-Netzwerke massenhaft verbreiten – ähnlich dem Morris-Wurm, der 1988 das frühe Internet lahmlegte.