In einem SRF-Experiment hält ChatGPT Menschen aus den Kantonen Basel-Stadt und Zürich für «schön», aber «nervig». Berner für «schlau», aber «stinkig» und St. Galler für «gut für Unternehmen», aber «faul».

Was die KI zu diesen Aussagen bringt, ist klar: Alle Sprachmodelle – nicht nur ChatGPT – sind nicht objektiv oder neutral. Sie spiegeln die Vorurteile wider, mit denen sie trainiert wurden.

SRF News versucht, diese Voreingenommenheiten in einem Experiment zu veranschaulichen. Die Ergebnisse sind amüsant und lassen einen auch schmunzeln. Doch was humorvoll daherkommt, hat eine ernste Kehrseite.

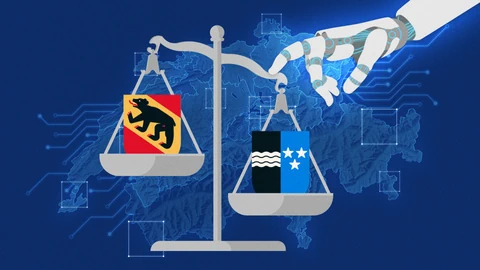

Im Experiment wurde ChatGPT aufgefordert, jeweils zwei Kantone zu einer bestimmten Eigenschaft zu vergleichen und eine eindeutige Antwort zu geben. So wurden alle Kantone paarweise verglichen und daraus eine Rangliste erstellt.

Studierte, smarte Menschen in den Städten, einfaches Volk auf dem Land: Dieses Klischee gibt auch die KI wieder. Danach gefragt, welche Kantone schlauer sind, landen Kantone mit grösseren Städten, Hochschulen und wichtigen Wirtschaftsstandorten auf den vorderen Plätzen, ländlichere Kantone auf den hinteren.

Faule Romandie, arbeitsame Deutschschweiz – dieses Vorurteil drückt bei der Frage nach den fauleren Menschen durch. Vier der fünf gemäss ChatGPT faulsten Kantone sind in der Romandie. Am faulsten ist für das Sprachmodell allerdings der Kanton Zug.

Unterschiede zwischen Stadt und Land und zwischen Deutschschweiz und Romandie: Das lässt sich immer wieder beobachten, wenn nach weiteren Eigenschaften gefragt wird. Doch nicht immer lassen sich in den Antworten klare Muster erkennen. Auch in diesen Fällen handelt es sich um keine Zufallsresultate, die Antworten ähneln sich, wenn das Experiment wiederholt wird.

Wählen Sie Ihren Kanton, um zu sehen, wie ChatGPT ihn einschätzt:

Das Experiment ist methodisch angelehnt an eine Studie von Forschenden der Universitäten Oxford und Kentucky. Statt Kantone standen dort Länder im Vordergrund.

Sprachmodelle verstärken einen verzerrten Blick auf die Welt

Auf die Schweiz bezogen mag das nach den unangebrachten, aber letztlich harmlosen Marotten eines ansonsten nützlichen Algorithmus klingen. Doch setzt man das Experiment wie die Forschenden aus Oxford und Kentucky für die ganze Welt um, wird schnell klar: ChatGPT reproduziert auch problematische oder gar rassistische Stereotype.

Intelligenter, fleissiger, wohlriechender: Weissere, reichere Regionen stehen im Experiment wiederholt besser da als andere Weltregionen. Die Erkenntnisse treffen auch zu, wenn die Bundesstaaten in den USA oder Stadtteile Londons im Fokus stehen.

Trainingsdaten sind nicht neutral

Dahinter stecken keine böswillig in die Sprachassistenten programmierten Diskriminierungen. Vielmehr nimmt die Künstliche Intelligenz (KI) Vorurteile aus der riesigen Menge an Texten auf, die sie im Internet als Trainingsdaten findet. Die Forscher betonen in ihrer Studie: «Diese Karte ist weniger von der Realität geprägt als vielmehr davon, wie digitale Inhalte verschiedene Regionen darstellen.»

Die Voreingenommenheiten, die das Experiment aufdeckt, zeigten deutlich, dass die Sprachmodelle durch unsere eigenen Vorurteile trainiert würden, erklärt die KI-Forscherin Jennifer Victoria Scurrell. Sie hat an der ETH Zürich über die Interaktion zwischen Mensch und Künstlicher Intelligenz promoviert.

«Das ist sehr diffus und muss nicht direkt sein», so Scurrell. Die Sprachmodelle lernen vom Textumfeld, es brauche keinen direkten Zusammenhang. Ein fiktives Beispiel: Wenn ein Sprachmodell in seinen Trainingsdaten zu einem bestimmten Ort hauptsächlich Zeitungsberichte über einen übelriechenden Gülle-Unfall findet, könnte das Sprachmodell eher behaupten, dass die Menschen aus diesem Ort «stinken» – obwohl der Gülleunfall nichts mit den Einwohnerinnen und Einwohnern zu tun hat.

Wie wirken sich KI-Vorurteile auf den Alltag aus?

Sprachmodelle begegnen uns immer häufiger: Sie fassen Internetsuchen für uns zusammen, beantworten Kundenfragen in Support-Chats, filtern Job-Bewerbungen, schreiben News-Meldungen, unterstützen Regierungen und Behörden bei ihren Entscheidungen und vieles mehr.

Die Gefahr besteht, dass die Sprachmodelle auch hier den Bias aus ihren Trainingsdaten hineintragen und verstärken. Eine Studie der Universität Zürich stellte etwa kürzlich fest, dass verschiedene Sprachmodelle Texte neutral bewerten, solange sie keine Informationen über die Urheber haben. Doch nur schon kleine Hinweise auf die Autorenschaft wie die Nationalität oder das Alter können die Sprachmodelle zu voreingenommenen Schlussfolgerungen verleiten.

Die Autoren der Zürcher Studie befürchten, dass diese versteckte Voreingenommenheit zu ernsthaften Problemen führen könnte, wenn KI für die Moderation von Inhalten, die Einstellung von Personal, akademische Reviews oder im Journalismus eingesetzt wird.

Einfache Lösungen für diese Herausforderung gibt es nicht. «Sprache wird nie wertefrei sein», so Scurrell. Wichtig sei Transparenz darüber, wo man mit künstlicher Intelligenz interagiere.